KI-Agenten: Kontextbasierte Intelligenzprofile als Booster für Marken

Eine DMEXCO Kolumne von Evgeny Popov über KI-Agenten und die Revolution kontextbezogener Werbung.

Wie Marken mit Kontext-Agenten künftig zu intelligenteren Entscheidungen finden

Marketer:innen benötigen zunehmend granularere Einblicke, automatisierte Prozesse und intelligente Entscheidungsunterstützung in der Mediaplanung. Doch die herkömmlichen NLP-basierten Systeme – einst als bahnbrechend geltend – stoßen an ihre Grenzen. Sie sind den fragmentierten, signalreichen und authentischen Medienumgebungen von heute nicht mehr gewachsen. Während die Entwicklung Künstlicher Intelligenz rasant voranschreitet, ist bereits die nächste Evolutionsstufe erreicht: Agentenbasierte KI-Systeme, die Sprache nicht nur verstehen, sondern dynamisch, kontextsensitiv und strategisch darauf reagieren.

Im Zentrum dieses Wandels steht das Zusammenspiel von Natural Language Understanding (NLU) und kontextbasierten KI-Agenten – eine leistungsstarke Kombination, die Werbetreibenden den Schritt vom reinen Keyword Targeting hin zu einer multidimensionalen, kontextgetriebenen Mediaplanung in Echtzeit ermöglicht. NLU, ein Teilbereich von NLP (Natural Language Processing), hat sich längst zu einer entscheidenden Grundlage entwickelt, um Nutzer:innen-Intentionen, Sentiment und semantische Bedeutung tiefgreifend zu interpretieren. Doch die nächste Grenze ist nicht nur linguistisch – sie ist agentisch: Systeme, die nicht nur verstehen, sondern eigenständig agieren, priorisieren, adaptieren.

Diese Kolumne beleuchtet, wie genau diese Konvergenz funktioniert, wie sie sich mithilfe von JSON-basierten Ausgabeformaten technisch operationalisieren lässt – und wie sie die Herangehensweise an Eignung, Targeting, Personalisierung und Performance in der kontextbezogenen Werbung grundlegend verändert. Diese Synthese birgt das Potenzial für einen echten Paradigmenwechsel in der Nutzer:innen-Ansprache: KI-Systeme analysieren Sprache nicht mehr nur, sondern reagieren agentisch, personalisiert und präzise – in Echtzeit, im richtigen Moment, im richtigen Kontext.

Die Grenzen reiner NLU-Anwendungen

Natural Language Understanding (NLU) analysiert menschliche Sprache, strukturiert sie semantisch und extrahiert Intentionen, Emotionen, Themen und Stimmungen. Im Marketing kommt NLU beispielsweise bei Chatbots, Social Listening, Content-Moderation oder der semantischen Suche zum Einsatz. Doch diese Systeme agieren in der Regel zustandslos und reaktiv. Sie beantworten Fragen wie:

- Worum geht es in diesem Artikel?

- Ist das Sentiment positiv oder negativ?

- Welches Produkt wurde erwähnt?

So nützlich diese Einblicke auch sind – es fehlt an langfristigem Kontext, strategischer Zielausrichtung und einem „Gedächtnis“. NLU erkennt nicht, ob ein Inhalt bzw. eine Content Opportunity zu der übergeordneten Botschaft, den Assets und KPIs einer Marke passt oder mit konkurrierenden Platzierungen kollidiert. Auch weitere Risikofaktoren oder Engagement Scores bleiben für reine NLU-Systeme außerhalb des Blickfelds.

Kontext-Agenten schließen die Lücke

Kontextbasierte KI-Agenten beziehungsweise Kontext-Agenten, wie sie unter anderem in The End of Taxonomy auf bokonads.com beschrieben werden, gehen weit über klassische NLU-Systeme hinaus. Sie agieren als persistente, sich selbst aktualisierende Intelligenzprofile: Sie behalten ihren Zustand im Zeitablauf bei, passen sich dynamisch an Ziele an, lernen aus Feedback – und treffen Media-Entscheidungen über mehrere Dimensionen hinweg. Für Werbetreibende bedeutet dies, dass sie Inhalte nicht mehr nur nach Relevanz oder Sentiment markieren, sondern Agenten einsetzen, die aktiv bewerten, ob ein bestimmtes Content-Umfeld, das Publikumsprofil und die kreative Strategie tatsächlich zusammenpassen – und ob sich eine Investition lohnt.

Ein ganzheitlicher Bewertungsrahmen

Um die Analyse praxisnah zu operationalisieren, haben wir ein Schema entwickelt, das die typischen Fragestellungen von Marketer:innen erweitert und strukturiert:

- Ist der spezifische Inhalt markensicher?

- Passt der Inhalt zu unserer Markenidentität?

- Welche Botschaft wollen wir vermitteln – oder welches Produkt steht im Fokus?

- Welche kreativen Assets sind dafür geeignet?

Aber die tatsächliche Umsetzung erfordert mehr – eine fortschrittliche kontextuelle Bewertung berücksichtigt zusätzlich die folgenden Fragen:

- Entspricht das Publikum dem gewünschten Zielgruppensegment?

- Wie könnte sich der Inhalt auf die Markenwahrnehmung auswirken?

- Ist der Content aufmerksamkeitsstark genug, um unsere Anzeige herauszuheben?

- Passt der Inhalt zur aktuellen Kampagnenphase (Awareness, Consideration, Conversion)?

- Bestehen Wettbewerbsrisiken im direkten Umfeld?

- Ist der Content kulturell und zeitlich relevant?

- Ist das Umfeld mess- und attributierbar?

- Entspricht der Inhalt den rechtlichen Anforderungen und den Richtlinien der Plattform?

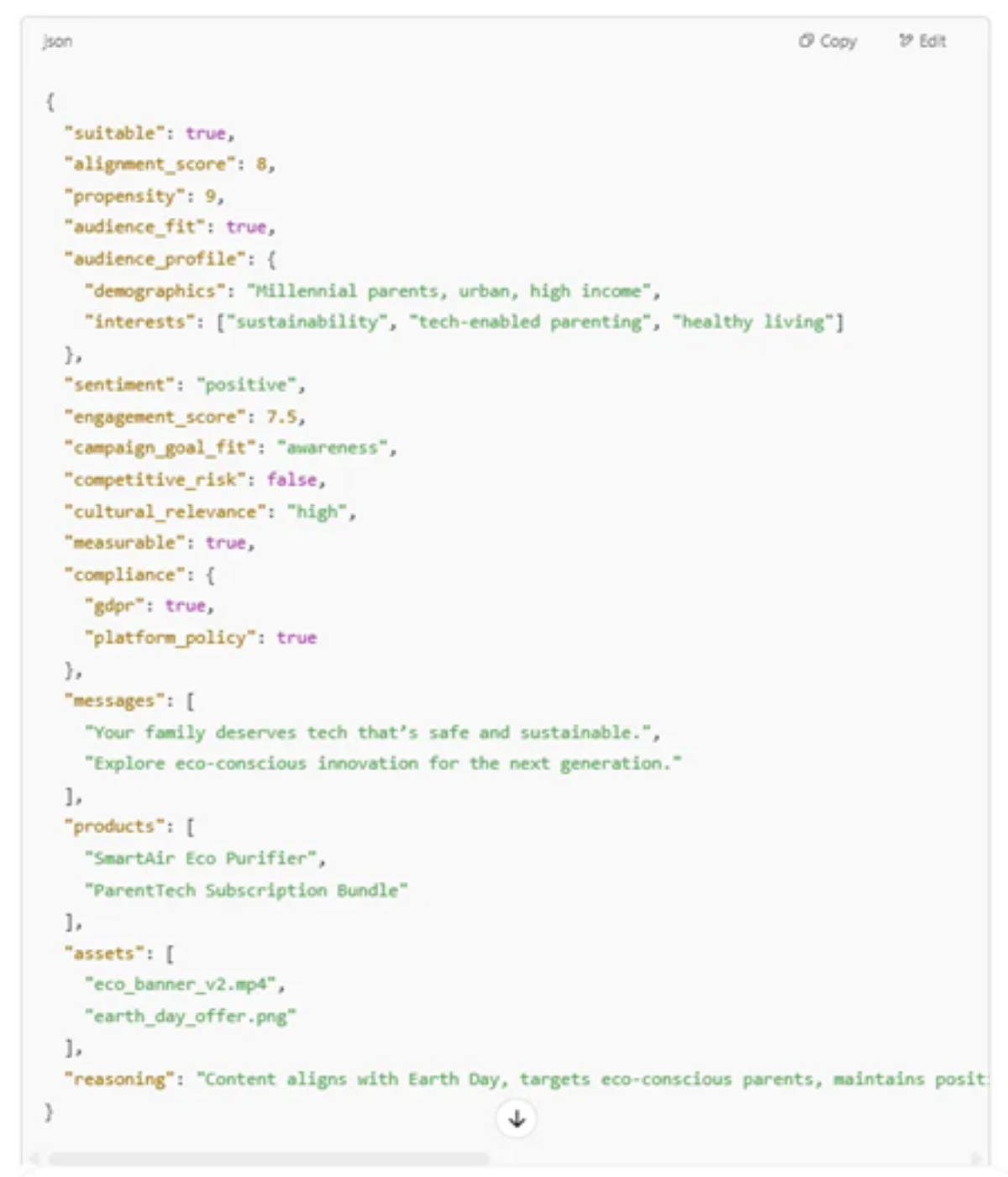

Das JSON-Schema – strukturierte Intelligenz für programmatische Entscheidungen

Das JSON-Schema zeigt beispielhaft, wie ein kontextbasierter KI-Agent Informationen analysiert und daraus fundierte Entscheidungen ableitet:

Ein konkretes Beispiel – Szenario: Marke trifft auf Content

🏷 Marke:

EcoTech Living – eine nachhaltige Smart-Home-Marke mit Fokus auf Millennials mit Familie.

🎯 Produkte:

- SmartAir Eco Purifier

- ParentTech Abo-Paket

📍 Kampagnenziel:

Top-of-Funnel – Markenbekanntheit im Rahmen einer Earth-Day-Kampagne stärken.

📺 Content Opportunity:

Artikel auf ParentingGreenLife.com mit dem Titel: „How Millennial Parents Are Leading the Sustainability Movement“.

- Positives Sentiment

- Hohes Engagement auf Social Media

- Zielgruppe: urbane, nachhaltigkeitsorientierte Eltern

- Thematischer Aufhänger: Earth Day

- Keine Platzierungen von Wettbewerbern

- Konform mit Datenschutzrichtlinien und den Anzeigenstandards der Plattform

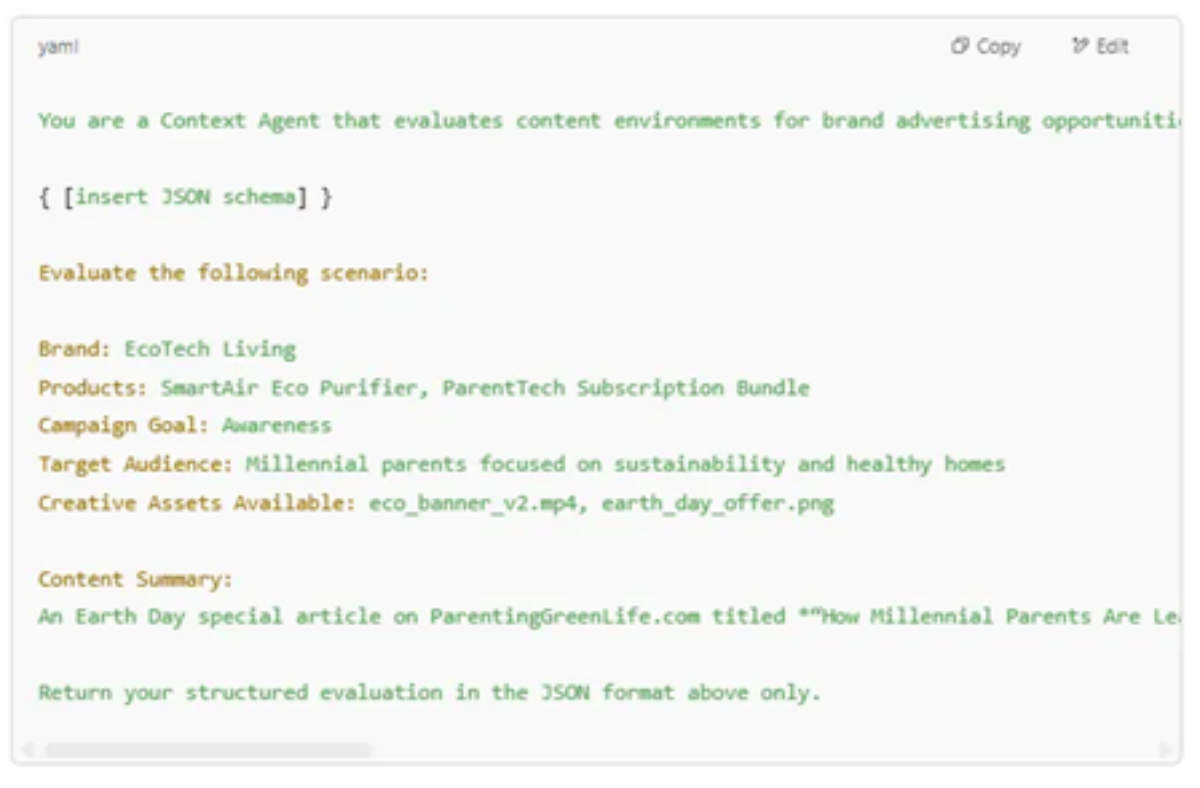

Eingabeaufforderung mit eingebettetem Schema

Hier ein Beispiel für eine systemseitige Prompt-Struktur, wie sie in Large Language Models (LLMs) oder unternehmenseigenen Media Tools eingebunden werden kann, um die oben dargestellte strukturierte Ausgabe zu erzeugen:

Von der Theorie zur Praxis – strategische Einsatzfelder

Der vorgestellte Rahmen geht damit weit über ein theoretisches Konzept hinaus: Er ermöglicht ein skalierbares System für agentengestützte Mediaplanung in Echtzeit. Mögliche Anwendungsfelder sind unter anderem:

- Entscheidungs-Engines in DSPs und SSPs

- Markensicherheits-Tools mit NLU Layering

- Personalisierung in Retail Media

- Programmatische Werbung mit dynamischer Anzeigenoptimierung

- Media-Mix-Modellierungs-Feeds

- Qualitätssicherung und Compliance-Checks in Kampagnen

Kontextbasierte KI-Agenten verändern darüber hinaus die Art und Weise, wie Marketing-Teams mit Partnern zusammenarbeiten – vom Briefing über das Placement-Audit bis hin zur kreativen, plattformübergreifenden Optimierung.

Der Ruf nach einer agentischen Infrastruktur

Um diese Vision branchenweit zu skalieren, braucht es eine Öffnung hin zu einer neuen, agentisch geprägten Infrastruktur:

- Komponierbare KI-Architekturen, in denen NLU-Module über Schnittstellen in persistente Agentenzustände integriert werden können.

- Transparente Reasoning-Schichten, die eine nachvollziehbare Überprüfung und Optimierung agentischer Entscheidungen ermöglichen.

- Kontextbasierte Feedback-Schleifen, bei denen jede Nutzer:innen-Interaktion die Wissensbasis des Agenten verfeinert und weiterentwickelt.

Agentenbasierte Systeme sind weit mehr als ein UX-Upgrade – sie sind ein geschäftlicher Imperativ. In einer Welt, in der First-Party-Daten zur neuen Norm werden und traditionelle Zielgruppensegmentierung an Bedeutung verliert, brauchen Marketer:innen Systeme, die lernen, sich anpassen und eigenständig handeln – ohne auf manuelle Regel-Updates angewiesen zu sein.

KI-Agenten gehört die Zukunft

Die Konvergenz von Natural Language Understanding und kontextbasierten KI-Agenten ist weit mehr als ein technisches Upgrade – sie markiert einen Paradigmenwechsel. Medienintelligenz entwickelt sich weg von starren Taxonomien und segmentbasierten Modellen hin zu dynamischen, adaptiven Systemen, die im Takt digitaler Interaktionen agieren – kontextbewusst, lernfähig und strategisch.

Durch die Strukturierung des Ausgabeformats per JSON können Teams Erkenntnisse plattformübergreifend operationalisieren – über KI-Workflows, Marketing-Clouds und programmatische Systeme hinweg. Die Entscheidungsfindung wird so von subjektiv und manuell auf automatisiert und intelligent gehoben.

NLU wird damit zum Motor, der die semantische Tiefe erschließt – und aufzeigt, wie Sprache Bedürfnisse, Absichten, Bedenken, Neigungen und Emotionen ausdrückt. Kontextbasierte KI-Agenten wiederum sind das ausführende Organ: Sie verbinden Worte mit Strategien, Semantik mit Mediaplanung, Analyse mit Handlung. Wird dieses Modell skalierbar implementiert, liefert es mehr als nur Relevanz. Es erzeugt ein tiefes Verständnis – es erkennt, wie Menschen sprechen, fühlen und denken. Und es weiß, wie man darauf reagiert, Kund:innen erreicht und Beziehungen aufbaut.

In einer Welt, in der Aufmerksamkeit flüchtig und Personalisierung zur Währung wird, genügt es nicht mehr, Sprache nur zu verstehen. Maschinen müssen lernen, mit Einsicht, Kontext und Einfühlungsvermögen zu handeln. Die Zukunft des Marketings ist nicht nur konversationell. Sie ist agentisch. So trifft Sprache auf Logik. Und Werbung auf ihre Zukunft.

Verpass keine wichtigen Neuigkeiten aus der digitalen Marketing-Welt, national und international! Abonniere den neuen DMEXCO Newsletter „Digital Digest“ und erhalte jeden Montag, Mittwoch und Freitag die aktuellen Infos direkt in dein Postfach.